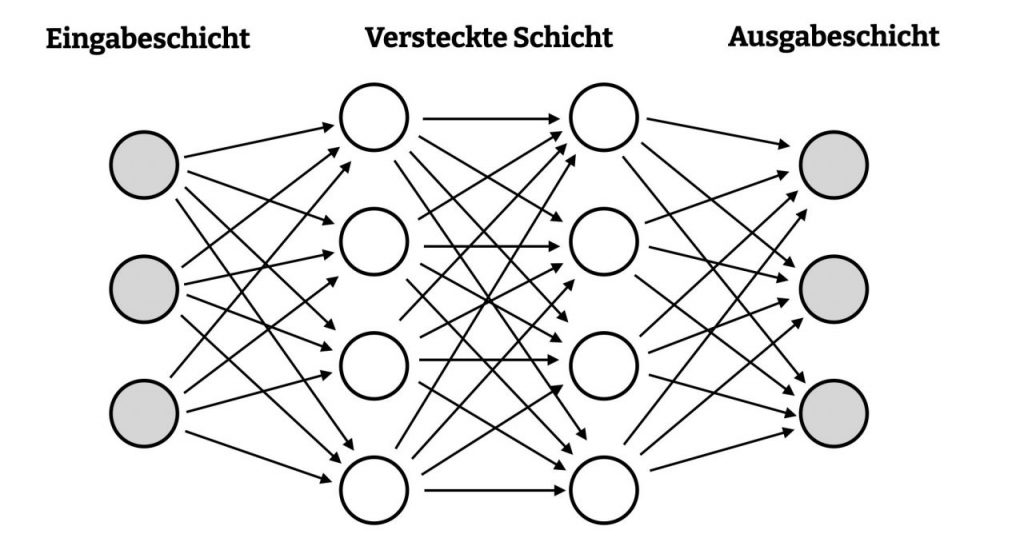

Neuronale Netze sind ein weit gefächertes Gebiet der künstlichen Intelligenz und des maschinellen Lernens. Neuronale Netze sind computergestützte Modelle, die sich an der Funktionsweise des menschlichen Gehirns orientieren und zur Verarbeitung und Analyse von Daten verwendet werden. Sie bestehen aus einer Vielzahl von künstlichen Neuronen, die in Schichten organisiert sind und miteinander verbunden sind.

Es gibt verschiedene Arten von neuronalen Netzen, die für unterschiedliche Aufgaben und Anwendungsbereiche optimiert sind:

Feedforward Neural Networks (FNNs)

Die einfachste Form neuronaler Netze, bei denen die Informationen nur in eine Richtung (vorwärts) von den Eingabeneuronen zu den Ausgabeneuronen fließen.

Anwendung: Bild- und Texterkennung, einfache Klassifikationsaufgaben.

Convolutional Neural Networks (CNNs)

Speziell für die Verarbeitung von Bilddaten entwickelt. Verwendet Faltungsschichten (Convolutional Layers) zur Extraktion von Merkmalen aus den Eingabebildern.

Anwendung: Bilderkennung, Objekterkennung, medizinische Bildverarbeitung.

Recurrent Neural Networks (RNNs)

Entwickelt für sequenzielle Daten. Verfügt über Rückkopplungen, sodass Informationen in die vorherigen Schichten zurückgeführt werden können.

Anwendung: Sprachverarbeitung, Zeitreihenanalyse, maschinelle Übersetzungen.

Long Short-Term Memory Networks (LSTMs)

Eine spezielle Art von RNN, die das Problem des verschwindenden Gradienten löst und sich besser für Langzeitabhängigkeiten in Daten eignet.

Anwendung: Sprachgenerierung, Übersetzungen, Zeitreihenprognosen.

Generative Adversarial Networks (GANs)

Besteht aus zwei Netzwerken, einem Generator und einem Diskriminator, die gegeneinander antreten. Der Generator versucht, realistische Daten zu erzeugen, während der Diskriminator versucht, echte Daten von gefälschten zu unterscheiden.

Anwendung: Bildgenerierung, Videospielentwicklung, Datenaugmentation.

Autoencoder

Ein neuronales Netz, das darauf trainiert wird, Eingabedaten in eine komprimierte Form zu kodieren und sie dann wiederherzustellen. Besteht aus einem Encoder und einem Decoder.

Anwendung: Datenkomprimierung, Anomalieerkennung, Bilderrauschreduktion.

Transformer Networks

Verwendet Selbstaufmerksamkeitsmechanismen, um die Abhängigkeiten zwischen verschiedenen Positionen in der Eingabesequenz zu erfassen. Hat sich in der Verarbeitung natürlicher Sprache als sehr effektiv erwiesen.

Anwendung: Maschinelle Übersetzung, Textzusammenfassung, Sprachverarbeitung.

Fazit

Diese Vielfalt an neuronalen Netzen ermöglicht es, für unterschiedliche Problemstellungen und Datentypen spezialisierte Modelle zu entwickeln, die oft erstaunliche Ergebnisse in der Praxis liefern.