Die Mixture-of-Experts (MoE)-Architektur ist ein faszinierender Ansatz im Bereich des maschinellen Lernens, der es Modellen ermöglicht, effizienter und leistungsfähiger zu werden. Die MoE-Architektur ist ein Machine-Learning-Ansatz, der darauf abzielt, die Leistung von Modellen durch die Kombination mehrerer spezialisierter Submodelle – sogenannte Experten – zu verbessern.

Kernkonzept

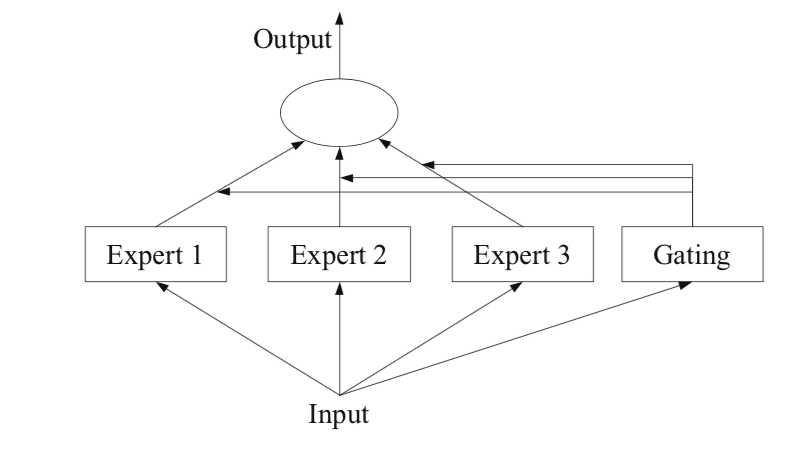

MoE besteht aus den folgenden Hauptkomponenten:

- Expertennetzwerke (Experts): Das Modell besteht aus mehreren „Experten“, wobei jeder Experte ein kleines neuronales Netzwerk ist, das auf eine bestimmte Teilmenge von Aufgaben oder Daten spezialisiert ist. Jeder Experte ist für einen bestimmten Aspekt des Problems optimiert.

- Gate-Netzwerk (Router): Lernt für jede eingegebene Aufgabe oder Datenpunkt den am besten geeigneten Experten auszuwählen oder eine Kombination von Experten zu gewichten.

- Kombination der Expertenausgaben: Die Ausgaben der ausgewählten Experten werden dann kombiniert, um das endgültige Ergebnis zu erzeugen.

Beispiel: Ein Kundenservice-System hat Experten für jede Sprache (Deutsch, Englisch, Spanisch, Französisch). Das Gate-Netzwerk leitet jede Anfrage an den passenden Sprachexperten weiter. So wird jede Anfrage effizient und präzise bearbeitet.

Vorteile der MoE-Architektur

- Effizienz: Da jeder Experte nur für einen Teil der Aufgaben zuständig ist, kann das Modell insgesamt effizienter trainiert werden. Es müssen nicht alle Parameter für jede Aufgabe angepasst werden.

- Skalierbarkeit: Ermöglicht extrem große Modelle mit Milliarden von Parametern, ohne dass alle Parameter gleichzeitig genutzt werden müssen.

- Spezialisierung: Jeder Experte kann sich auf bestimmte Muster oder Merkmale in den Daten spezialisieren, was zu einer höheren Genauigkeit führen kann.

Anwendungsbereiche und

MoE-Architekturen werden in verschiedenen Bereichen eingesetzt, wie z.B.:

- Sprachmodelle: In großen Sprachmodellen wie GPT-4 wird MoE verwendet, um die Effizienz zu steigern und die Leistung zu verbessern.

- Bilderkennung: MoE kann in der Bilderkennung eingesetzt werden, um verschiedene Aspekte eines Bildes zu analysieren.

- Empfehlungssysteme: MoE kann in Empfehlungssystemen verwendet werden, um personalisierte Empfehlungen zu geben.

Berichten zufolge nutzt OpenAI in seinem Sprachmodell GPT-4 eine MoE-Architektur mit 16 Experten, um Aufgaben wie Übersetzung, Stimmungsanalyse und Beantwortung von Fragen effizient zu bewältigen.

Herausforderungen

MoE bietet enorme Vorteile in Skalierbarkeit und Effizienz, aber es bringt auch Herausforderungen mit sich – insbesondere beim Training (erhöht die Komplexität), bei der Speicherverwaltung (hoher Speicherbedarf) und beim Deployment (mehr Aufwand bei Bereitstellung). In der Praxis werden MoE-Modelle meist nur dort eingesetzt, wo ihre Vorteile den zusätzlichen Aufwand rechtfertigen, z. B. in großen Sprachmodellen oder spezialisierten Empfehlungssystemen.